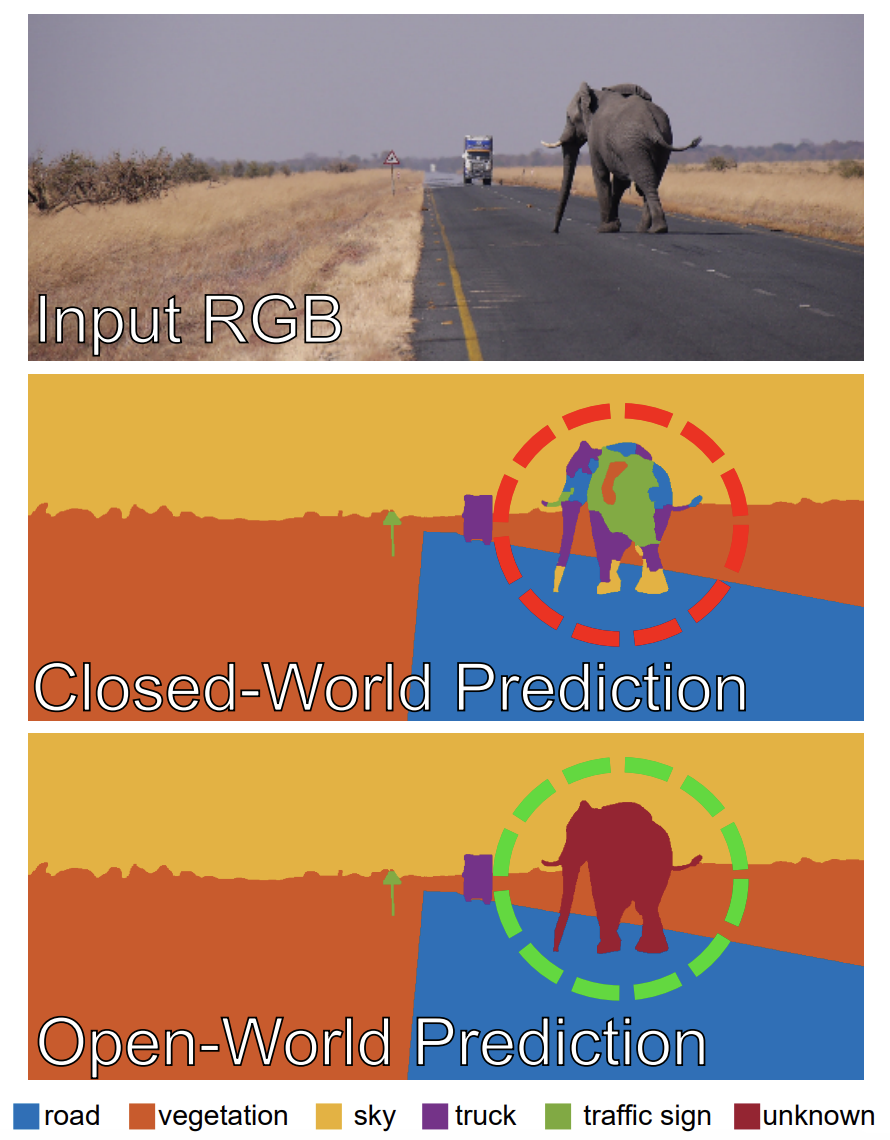

Open-world Semantic Segmentation for LIDAR Point Clouds https://arxiv.org/pdf/2207.01452 0. Abstract현재 LIDAR semantic segmentation 방법은 closed set, static 하기 때문에 real world에서 robust하지 않다. 그래서 저자들은 아래의 내용을 목표로 하는 LIDAR point cloud를 활용한 open-world semantic segmentation task를 제안한다.1) open-set semantic segmentation을 활용하여 기존의 class와 novel한 class를 모두 구분한다.2) 기존 class를 잊지 않고 incremental learning을 활용하여 기..