빈도확률(Frequentist probability)

10번 주사위를 던져 1이 나올 확률과 같은 빈도수를 측정하여 계산할 수 있는 확률

베이지안확률(Bayesian probability)

빈도수를 파악하기 힘들 때, 특정 명제가 참일 확률

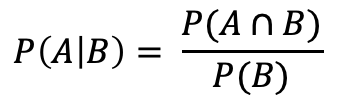

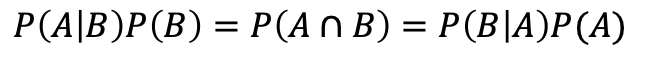

- 사후확률(posterior probability) P(A|B): B(결과)가 발생하였을 때 A(원인)가 발생했을 확률

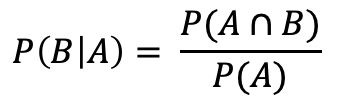

- 우도확률(Likelihood probability) P(B|A): A(원인)이 발생하였을 때 B(결과)가 발생할 확률

- 사전확률(prior probability) P(A): B(결과)가 나타나기 전에 결정되어 있는 A(원인)의 확률

From GPT

사전 확률 P(A)를 바탕으로 새로운 데이터 B가 주어졌을 때 사후 확률 P(A|B)을 계산한다.

이 사후 확률 P(A|B)는 다음 학습의 사전 확률 P(A)로 사용된다.

따라서 베이지안이론은 새로운 데이터를 통해 사전 확률이 갱신하는 과정이다.

유도과정

'Deep Learning' 카테고리의 다른 글

| AE(Auto Encoder), VAE(Variational Auto Encoder)이란? (0) | 2024.12.22 |

|---|---|

| Preicision, Recall, F1-Score, Sensitivity, PR Curve, ROC Curve, AUPR, AUROC, Confusion Matrix (0) | 2024.12.17 |

| Discriminative Learning, Generative Learning이란? (0) | 2024.12.16 |

| L1 Norm, L2 Norm / L1 Loss, L2 Loss 이란? (0) | 2024.12.11 |

| Entropy, Cross entropy loss란? (0) | 2024.04.28 |